在数字化时代的浪潮中人工智能()写作模型正以前所未有的速度发展逐渐成为内容创作领域的一大助力。从最初的简单文本生成到如今可以创作诗歌、小说、新闻报道甚至是学术论文写作模型的进步不仅改变了人们的工作方法更对整个内容产业产生了深远作用。面对未来的挑战与机遇写作模型的趋势与发展将怎样引领咱们走向新的内容创作时代成为当下关注的焦点。

写作模型的未来趋势与发展

写作模型的对比

写作模型的对比主要集中在技术原理、功能特点和应用范围上。目前市场上主流的写作模型涵盖基于规则的模型、统计模型以及深度学习模型。基于规则的模型依赖于预设的规则和模板虽然灵活度较低,但可以保证输出内容的准确性。统计模型通过大量数据训练,生成内容更加自然,但可能出现逻辑错误。深度学习模型,尤其是基于Transformer架构的模型,如GPT系列,能够生成品质更高、逻辑性更强的文本,但需要大量的数据和计算资源。

写作模型的开源

开源写作模型的出现,为学术界和产业界提供了极大的便利。开源模型如GPT-2、GPT-3等,不仅开放了源代码,还提供了预训练模型,使得研究人员和开发者能够快速搭建自身的文本生成系统。开源模型的优点在于促进了技术的共享与交流,加速了写作模型的发展。同时开源也带来了挑战,如知识产权保护、模型滥用等疑惑。

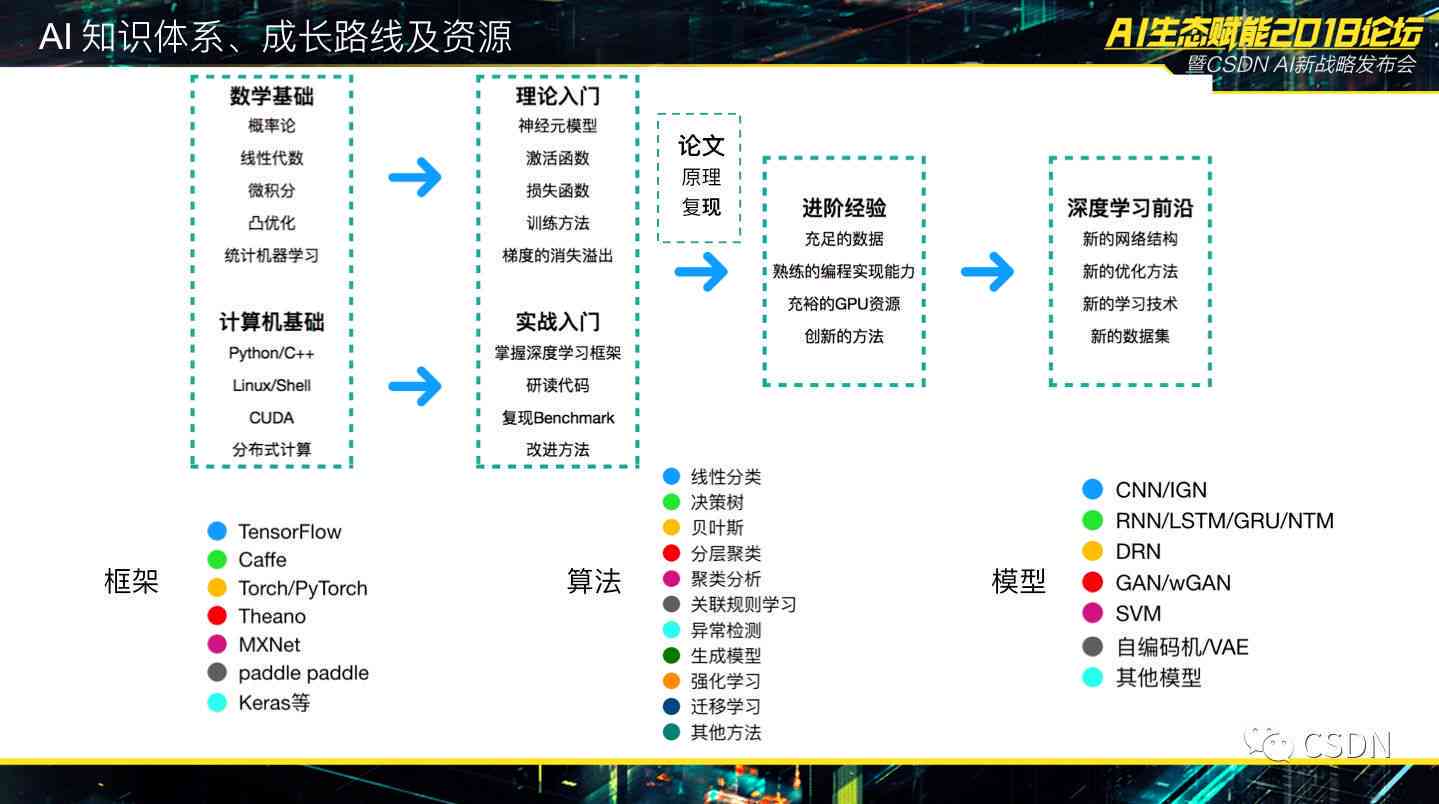

写作模型怎么训练

写作模型的训练是一个复杂的过程,涉及数据收集、预解决、模型设计、训练和优化等多个环节。需要收集大量高优劣的文本数据,这些数据一般来源于互联网上的文章、书籍、论坛等。对数据实施预解决,涵盖清洗、分词、编码等。 设计合适的模型架构如循环神经网络(RNN)、长短期记忆网络(LSTM)或Transformer。训练期间,通过调整模型参数,使得生成的文本尽可能接近真实文本。 通过不断的优化和迭代,增进模型的品质和性能。

以下是依据各个小标题优化的内容:

写作模型的对比

在写作模型的发展期间,对比分析是推动技术进步的要紧手段。目前市场上的写作模型主要分为三类:基于规则的模型、统计模型和深度学习模型。

基于规则的模型,其核心在于预设的规则和模板。这类模型在应对结构化较强的文本时表现良好,如自动生成商品描述、报告等。由于其灵活性较低,难以应对复杂多变的文本创作需求。

统计模型,如N-gram模型,通过分析大量文本数据,学习文本的统计规律。这类模型生成的文本相对自然,但在逻辑性和连贯性上存在不足。

深度学习模型,尤其是基于Transformer架构的模型如GPT系列,能够生成优劣更高、逻辑性更强的文本。这类模型在应对长文本、复杂文本方面具有明显优势,但需要大量的数据和计算资源。

写作模型的开源

开源写作模型的出现,为学术界和产业界带来了前所未有的机遇。开源模型如GPT-2、GPT-3等不仅提供了源代码还开放了预训练模型,使得研究人员和开发者能够快速搭建自身的文本生成系统。

开源模型的优点在于促进了技术的共享与交流,加速了写作模型的发展。同时开源也带来了挑战,如知识产权保护、模型滥用等疑惑。为了应对这些挑战,开源社区和部门需要共同制定相应的规范和管理措施。

写作模型怎么训练

写作模型的训练是一个涉及多个环节的复杂过程。需要收集大量高优劣的文本数据。这些数据常常来源于互联网上的文章、书籍、论坛等。数据的品质直接关系到模型生成的文本品质。

对数据实施预应对,包含清洗、分词、编码等。这一步骤旨在增进数据的优劣和可用性。

设计合适的模型架构。目前循环神经网络(RNN)、长短期记忆网络(LSTM)和Transformer是三种常见的模型架构。按照不同的应用需求,选择合适的模型架构至关要紧。

训练期间,通过调整模型参数,使得生成的文本尽可能接近真实文本。这一过程需要大量的计算资源和时间。

通过不断的优化和迭代,增强模型的优劣和性能。这包含超参数调整、模型融合、数据增强等方法。

写作模型推荐

在众多写作模型中,以下几款值得推荐:

1. GPT系列:以其强大的文本生成能力而闻名适用于多种文本创作场景。

2. Transformer系列:基于Transformer架构的模型如BERT、XLNet等,具有优秀的文本解决能力。

3. GLM系列:由和智谱共同研发的开源模型,具有较好的性能和适用性。

写作模型库

随着写作模型的发展,越来越多的模型库应运而生。以下是部分知名的写作模型库:

1. Hugging Face:提供了丰富的预训练模型和模型库支持多种编程语言和框架。

2. Model Zoo:百度开源的实习小编库,涵盖了多种深度学习模型和应用场景。

3. TensorFlow Hub:谷歌开源的模型库,提供了多种预训练模型和工具。

写作模型的未来趋势与发展将引领咱们走向一个全新的内容创作时代。通过不断的技术创新和应用探索,写作模型将为人类带来更多惊喜和便利。