文章正文

文章正文

写作是什么意思?

写作即人工智能写作是指借助人工智能技术生成文本内容的过程。它基于自然语言应对(NLP)和机器学习技术通过大规模的语料库和预训练模型来模仿人类的写作能力。写作是指利用人工智能技术让计算机程序可以自动产生文章、新闻、故事等文本内容的过程。它通过分析大量的数据和语言模型模仿人类的写作风格和思维办法。

写作的原理

写作的核心在于自然语言应对(NLP)和机器学习技术。NLP是计算机科学领域与人工智能领域中的一个必不可少方向它研究的是怎样去让计算机理解、解释和生成人类语言。NLP技术包含分词、词性标注、命名实体识别、句法分析、情感分析、文本分类等多个子领域。这些技术使得计算机能够理解和解决人类语言为写作提供了基础。

机器学习是写作的另一大支柱。机器学习是一种使计算机能够在未有明确编程的情况下从数据中学习的技术。在写作中,机器学习算法通过对大量文本数据实行学习,从而掌握语言规律和写作技巧。此类学习过程多数情况下分为两个阶段:预训练和微调。预训练阶段利用无监督学习方法对大规模文本数据实施训练,使模型学会语言的基本规律;微调阶段则利用有监督学习方法,通过标注好的数据对模型实行进一步优化,使其更符合特定任务的需求。

写作的算法与模型详解

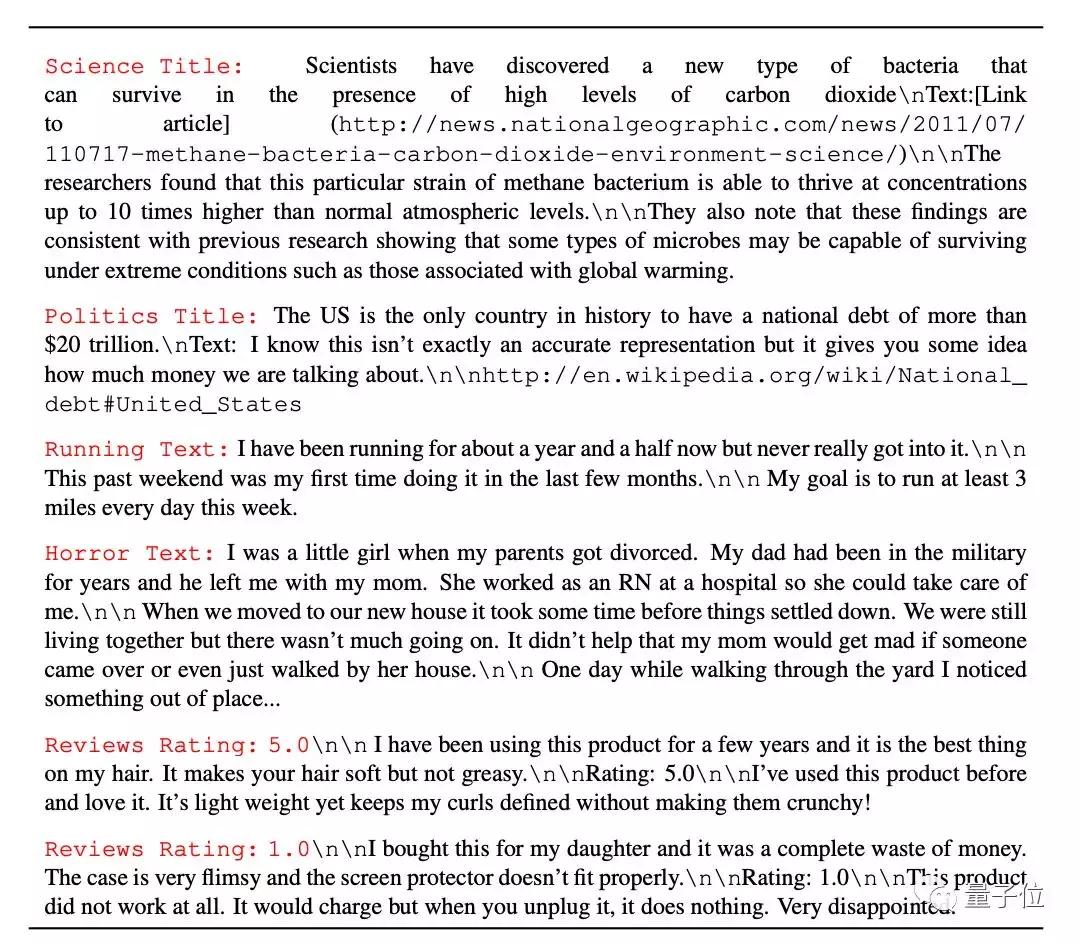

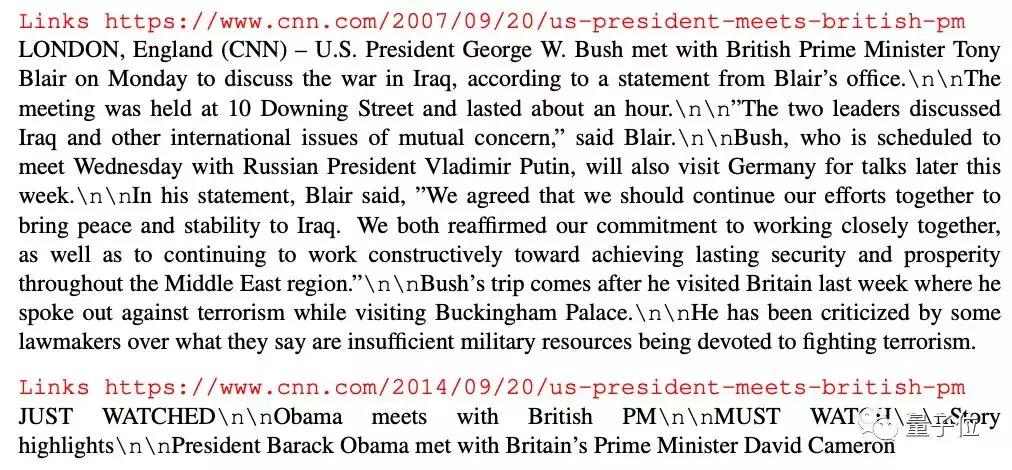

写作的算法和模型主要分为两大类:基于规则的方法和基于统计的方法。基于规则的方法主要依赖于专家知识和人工编写的规则,此类方法的优点是准确性高,但缺点是灵活性差,难以应对复杂的语言现象。基于统计的方法则通过机器学习算法对大量文本数据实行学习,从而掌握语言规律和写作技巧。此类方法的优点是灵活性强,可适应多种语言和文体,但需要大量的高优劣数据作为支撑。

基于统计的方法

基于统计的方法主要包含生成式模型和判别式模型两种类型。生成式模型旨在模拟整个文本生成过程如变分自编码器(VAE)、循环神经网络(RNN)等。这些模型通过学习输入数据的概率分布,从而生成新的文本。判别式模型则更加关注于文本分类和序列标注等任务如支持向量机(SVM)、条件随机场(CRF)等。这些模型通过学习输入数据和输出标签之间的映射关系,从而实现文本分类和序列标注等功能。

预训练模型

近年来随着深度学习技术的发展,基于预训练模型的写作技术得到了广泛应用。预训练模型是指在大规模未标注文本数据上实行预训练的深度学习模型。这些模型通过学习语言的基本规律和结构,从而具备了一定的语言理解能力。常见的预训练模型涵盖BERT、GPT-2、T5等。这些模型在预训练阶段通过自监督学习方法对大规模文本数据实行训练,从而掌握语言的基本规律;在微调阶段则通过有监督学习方法对特定任务的数据实行训练,从而增强模型的性能。

生成式模型

生成式模型是目前应用最广泛的写作模型之一。这类模型通过学习输入数据的概率分布,从而生成新的文本。其中,变分自编码器(VAE)是一种常用的生成式模型。VAE通过引入隐变量来建模数据的概率分布,并通过更大化似然函数来优化模型参数。此类方法的优点是能够生成高优劣的文本,缺点是生成的文本可能存在一定的重复性和单调性。

判别式模型

判别式模型则是另一种常用的写作模型。这类模型更加关注于文本分类和序列标注等任务。其中,支持向量机(SVM)是一种经典的判别式模型。SVM通过寻找一个更优超平面来区分不同类别的数据,并通过最小化结构风险来优化模型参数。此类方法的优点是可应对高维数据,缺点是对噪声敏感,容易过拟合。

总结

写作是指借助人工智能技术生成文本内容的过程。它基于自然语言应对(NLP)和机器学习技术,通过大规模的语料库和预训练模型来模仿人类的写作能力。写作是指利用人工智能技术,让计算机程序能够自动产生文章、新闻、故事等文本内容的过程。它通过分析大量的数据和语言模型,模仿人类的写作风格和思维途径。写作的原理主要包含自然语言应对技术和机器学习技术。其中,自然语言应对技术使得计算机能够理解和应对人类语言,而机器学习技术则使得计算机能够从数据中学习语言规律和写作技巧。