文章正文

文章正文

简介

人工智能()写作作为一种新兴的技术手段正逐渐改变着内容创作的模式。从新闻报道到文学作品从学术论文到日常通讯写作正在各个领域展现出巨大的潜力和价值。这项技术不仅极大地增进了写作效率还为人们提供了更多样化、更具创意性的内容选择。写作背后的原理和技术实现却并不简单。本文将深入探讨写作的原理、算法模型以及其在实际应用中的技术实现过程帮助读者更好地理解这一前沿科技。

写作是什么

写作是指通过机器学习和自然语言解决等技术使计算机可以自动生成文本内容的过程。它不仅仅是简单的文字拼接而是通过深度学习算法,让计算机具备理解上下文、生成连贯且富有逻辑性文本的能力。写作的应用范围广泛,涵盖但不限于新闻稿、产品描述、小说创作、剧本撰写、广告文案等。随着技术的发展,写作的输出品质不断升级,甚至可以达到与人类作家相媲美的水平。这类技术的应用不仅提升了内容创作的效率,也使得内容创作更加多样化和个性化。

写文原理

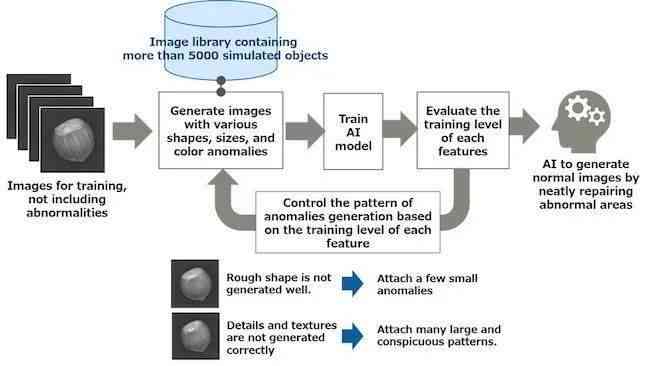

写文的原理主要依赖于自然语言应对(NLP)技术和深度学习算法。NLP技术使计算机可以理解人类语言,并将其转化为计算机能够解决的数据形式。深度学习算法则负责学习大量的文本数据,从中提取出语言模式和结构特征。具体而言写作常常会经历以下几个步骤:

1. 数据准备:收集大量高优劣的文本数据,作为训练模型的基础。

2. 预解决:对文本数据实施清洗、分词、标注等操作,以便于后续应对。

3. 模型训练:采用深度学习框架(如TensorFlow、PyTorch等)构建神经网络模型,通过反向传播算法不断调整模型参数,以最小化预测误差。

4. 文本生成:按照客户输入的提示词或关键词,模型生成相应的文本内容。

5. 后解决:对生成的文本实施润色和优化,使其更符合语法规范和语义逻辑。

写作算法

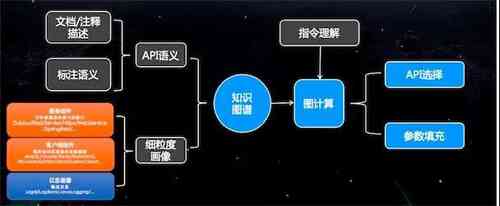

写作算法的核心是基于序列模型的生成式模型,如循环神经网络(RNN)、长短时记忆网络(LSTM)和Transformer等。其中,Transformer模型因其强大的并行计算能力和长距离依赖捕捉能力而被广泛采用。这些模型通过自留意力机制,能够在生成文本时考虑到上下文信息,从而生成更加连贯和合理的文本内容。

还有基于强化学习的算法,如策略梯度方法和对抗生成网络(GAN)。这些算法通过不断优化生成文本的品质使其更接近于真实的人类写作风格。例如,GAN通过生成器和判别器之间的博弈,逐步提升生成文本的真实性和多样性。

写作模型

写作模型的选择取决于具体的应用场景和需求。常见的模型涵盖GPT(Generative Pre-trned Transformer)系列和BERT(Bidirectional Encoder Representations from Transformers)系列。GPT系列模型擅长生成连续文本,能够依照给定的上下文生成连贯的段落或篇章。而BERT系列模型则侧重于理解和分析文本,常用于情感分析、问答系统等任务。

近年来大规模预训练模型的兴起使得写作模型的能力得到了显著提升。例如,Open发布的Davinci模型,通过在海量数据上实施预训练,具备了强大的文本生成和理解能力。这类模型不仅可生成高品质的文章,还可按照客户的指令实行特定风格的写作,如模仿某个著名作家的风格或适应某种文体请求。

总结

写作技术的发展为内容创作带来了革命性的变化。通过深度学习算法和自然语言应对技术,写作不仅能够提升写作效率,还能创造出多样化和个性化的文本内容。未来,随着技术的不断进步,写作将在更多领域发挥更大的作用,成为推动内容创作创新的必不可少力量。