文章正文

文章正文

探索写作算法模型的构建方法

随着人工智能技术的迅猛发展写作已成为一种新的创作途径。写作不仅可以帮助人们提升写作效率还能为写作提供更多的可能性。本文将详细介绍怎样去通过选择合适的模型架构搭建本身的写作以及怎么样利用这些工具实现高效而高优劣的写作。

确定目标:明确写作的功能

在开始构建写作算法模型之前首先要明确的具体功能。例如能够用于生成文章、提供写作建议、润色文本等。不同的功能对应着不同的模型架构和技术路线。若是需要生成文章,能够选择基于变换器(Transformer)的模型;倘若需要提供写作建议或润色文本可能更适合采用循环神经网络(RNN)或是说长短期记忆网络(LSTM)。 在确定目标时,必须明确写作的功能定位,以便后续选择合适的模型。

数据准备:收集和应对训练数据

数据是训练任何实习小编的基础。对写作对于,高优劣的数据尤为必不可少。需要收集大量的文本数据作为训练集。这些数据可来源于各种公开的文学作品、新闻报道、社交媒体等。为了保证数据的品质,还需要实施数据清洗和预应对,如去除无关字符、统一格式、分词等。还能够采用数据增强技术来增加数据的多样性,从而增进模型的泛化能力。

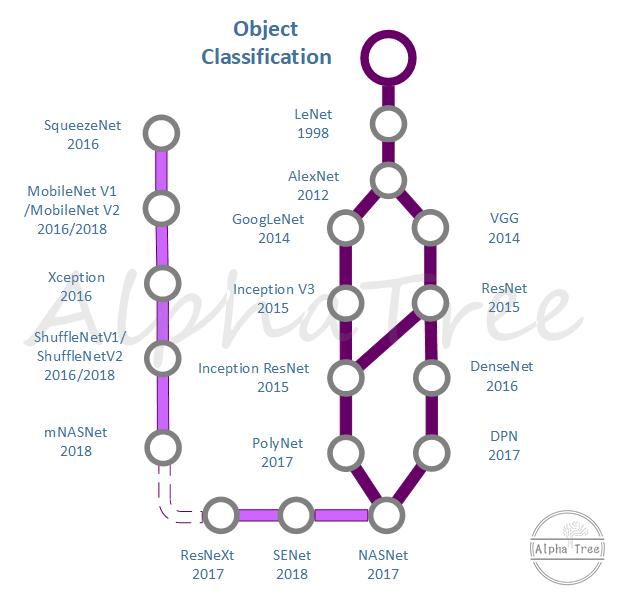

模型选择:常见模型及其特点

在写作中,常见的模型架构主要包含循环神经网络(RNN)、长短期记忆网络(LSTM)和变换器(Transformer)。每种模型都有其独到的优势和适用场景。

- 循环神经网络(RNN):RNN是一种能够解决序列数据的模型。它通过隐藏层中的状态传递机制,使得模型能够捕捉到时间序列中的长期依赖关系。虽然RNN在应对短文本方面表现良好,但它的训练速度较慢且容易出现梯度消失或爆炸的疑问。

- 长短期记忆网络(LSTM):LSTM是RNN的一种改进版本,通过引入门控机制,应对了RNN在解决长序列时存在的难题。LSTM能够更好地捕捉长期依赖关系,适用于应对较长的文本数据。LSTM的计算复杂度较高,训练时间较长。

- 变换器(Transformer):变换器是一种基于自关注力机制的模型,与RNN和LSTM相比,它能够并行解决序列数据,极大地提升了训练速度。变换器在多个自然语言应对任务上取得了卓越的成绩,尤其是在生成式任务中表现出色。但是变换器模型的参数量较大对硬件资源需求较高。

工具应用:实践写作

在完成上述准备工作后,就可着手构建写作系统了。实践中,可利用现有的深度学习框架和工具,如TensorFlow、PyTorch等,快速搭建模型并实施训练。同时还可借助若干开源项目和预训练模型,加速开发过程。例如,Hugging Face提供的Transformers库,包含了大量经过预训练的变换器模型,可直接应用于文本生成、情感分析等多种任务。还可结合客户反馈实行模型微调,以进一步提升模型性能。

结语

构建写作算法模型是一个系统工程,需要从确定目标、数据准备、模型选择到工具应用等多个环节综合考虑。随着技术的不断进步写作的应用范围将会越来越广泛,为人们的生活和工作带来更多便利。未来,咱们期待看到更多创新性的写作工具和应用,为人类的创作带来更大的价值。