文章正文

文章正文

深入解析:智能写作的核心原理与技术架构

随着科技的飞速发展人工智能()逐渐渗透到各个领域,其中智能写作作为一种新兴技术,正在改变着内容生产的传统模式。本文将从智能写作的核心原理、技术架构以及应用前景等方面实行深入解析。

一、智能写作的核心原理

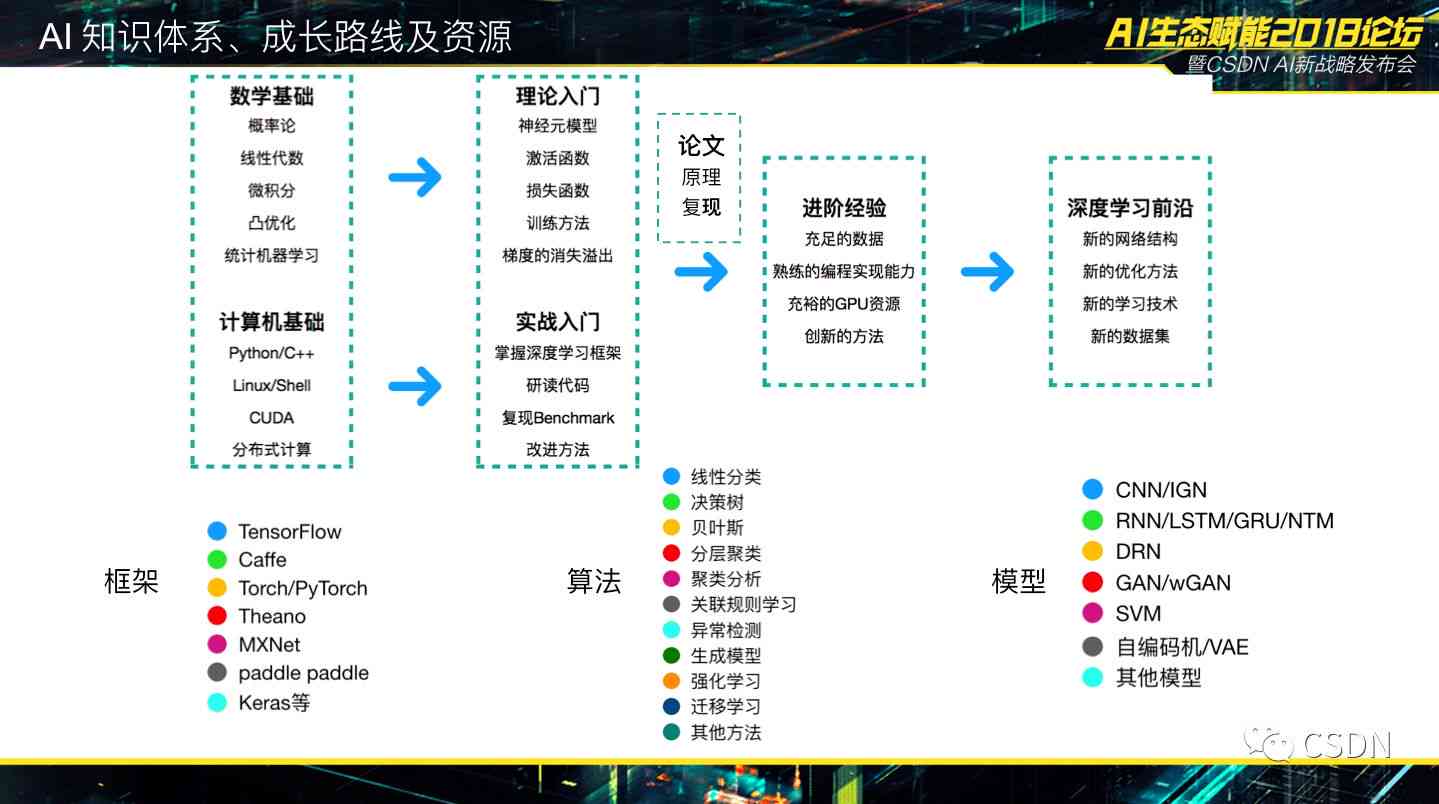

智能写作的核心原理主要基于自然语言应对(NLP)和机器学习技术。以下是智能写作的几个关键步骤:

1. 数据收集与预应对:写作的之一步是收集和准备训练数据。这些数据多数情况下来源于大规模的语料库,涵盖书籍、文章、网页等文本资源。通过对这些数据实施预应对,如清洗、分词、去停用词等操作为模型训练提供高优劣的输入数据。

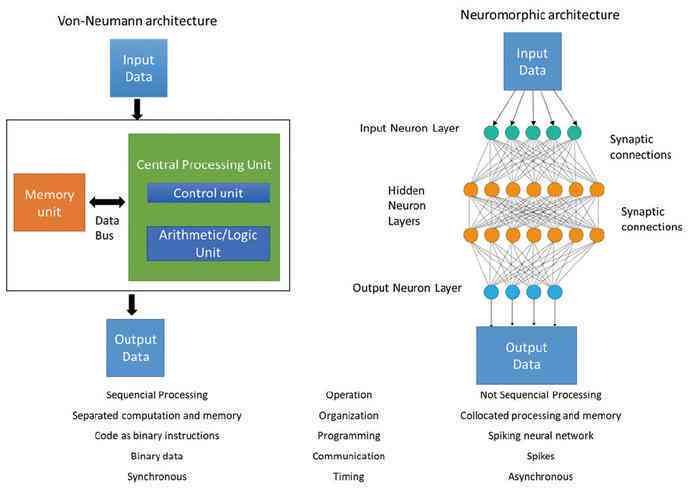

2. 模型训练:在收集到足够的训练数据后,系统会利用机器学习算法对模型实行训练。这一期间,模型会学习文本的特征和规律,如词频、语法结构、上下文关系等。常用的训练算法涵盖深度学习中的循环神经网络(RNN)、长短期记忆网络(LSTM)和Transformer等。

3. 文本生成:经过训练的模型可自动生成新的文本。这个过程常常涉及到解码器(Decoder)和关注力机制(Attention),使得生成的文本在语法、语义上更加合理。

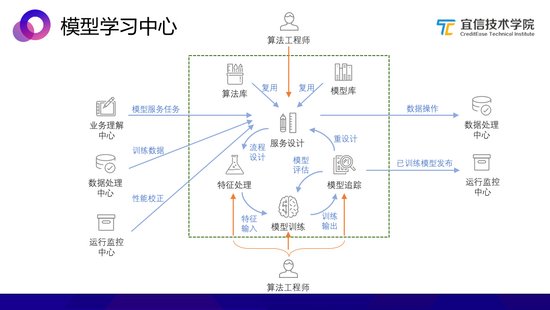

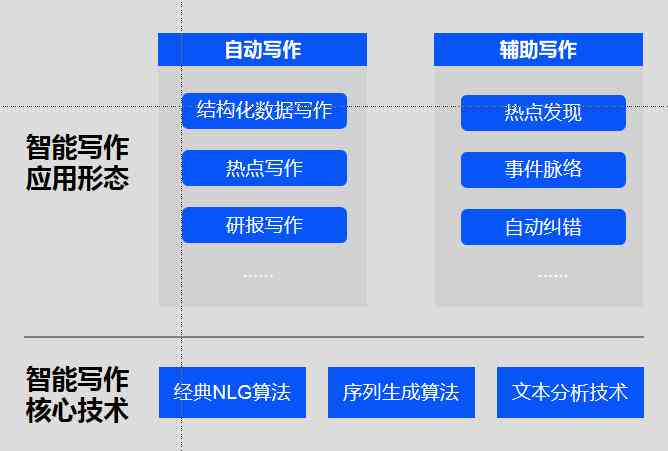

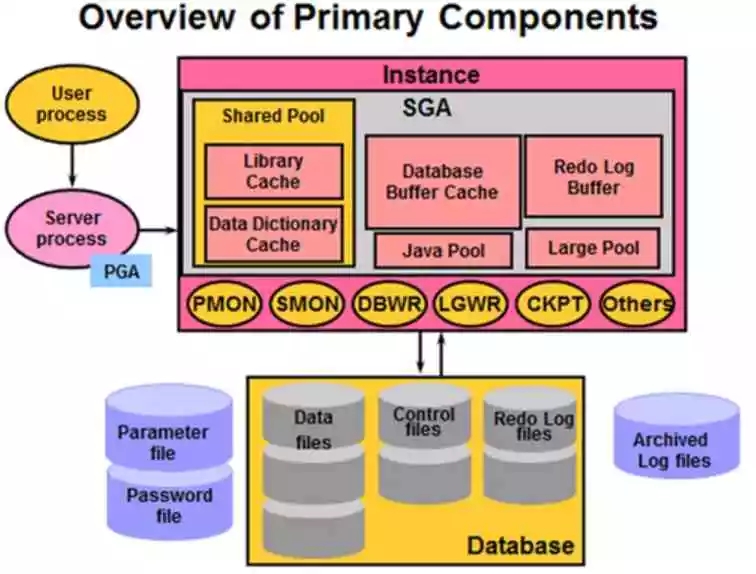

二、智能写作的技术架构

智能写作的技术架构主要包含以下几个层面:

1. 数据层:数据层是智能写作的基石,包含原始文本数据、预应对后的数据以及训练好的模型。数据层的优劣直接作用到写作系统的性能。

2. 模型层:模型层是智能写作的核心涵盖各种机器学习算法和模型。这些模型通过训练数据学习文本的规律,并生成新的文本。

3. 接口层:接口层是使用者与智能写作系统交互的桥梁。客户可以通过界面输入指令或文本,系统则依据这些指令生成相应的文本。

4. 应用层:应用层是智能写作的实际应用场景,涵盖新闻报道、广告文案、小说创作等。在这一层面,智能写作系统可以按照客户需求生成不同类型、风格的文本。

以下是智能写作技术架构的详细解析:

1. 数据层:

- 原始文本数据:涵盖书籍、文章、网页等文本资源。

- 预解决数据:通过分词、去停用词等操作提取文本中的有效信息。

- 训练数据:经过预解决的文本数据,用于模型训练。

2. 模型层:

- 词向量模型:将词汇映射为向量用于表示词义。

- 循环神经网络(RNN):通过时间序列数据,学习文本的序列特征。

- 长短期记忆网络(LSTM):在RNN的基础上,引入记忆单元,增强模型对长序列文本的解决能力。

- Transformer模型:利用关注力机制,增强模型对文本上下文的理解能力。

3. 接口层:

- 使用者界面:提供使用者输入指令和文本的界面。

- API接口:为其他应用程序提供调用智能写作系统的接口。

4. 应用层:

- 新闻报道:按照新闻的描述,生成新闻报道文章。

- 广告文案:依照产品特点,生成吸引人的广告文案。

- 小说创作:依照客户提供的主题或情节,生成小说文本。

三、智能写作的应用前景

智能写作的应用前景十分广阔,以下是几个主要方向:

1. 内容生产:在新闻、广告、营销等领域智能写作能够高效地生成大量的文本内容,升级生产效率。

2. 个性化写作:依照使用者的需求和喜好智能写作能够生成个性化的文本,如小说、诗歌等。

3. 辅助写作:在学术研究、论文撰写等领域,智能写作能够提供辅助性的写作支持,如自动生成摘要、参考文献等。

4. 语言学习:智能写作可用于语言学习,帮助学习者加强写作能力,如语法纠正、写作建议等。

智能写作作为一种新兴技术具有广泛的应用前景和巨大的市场潜力。随着技术的不断进步,咱们有理由相信,智能写作将在未来成为内容生产的关键工具,为人们的生活和工作带来更多便利。