文章正文

文章正文

深度学习实验综述:神经网络算法的应用、优化与实践反思

引言

随着人工智能技术的快速发展神经网络算法在众多领域中得到了广泛应用。本文旨在通过实践深入探讨神经网络算法在具体疑问中的应用分析其优缺点,并总结实践经验。本报告将重点介绍BP神经网络算法的简单实现、卷积神经网络(CNN)的应用,并结合机器学习的基础知识,为读者提供一个全面的视角。

一、BP神经网络算法的简单实现

# 1. 神经网络的基本概念

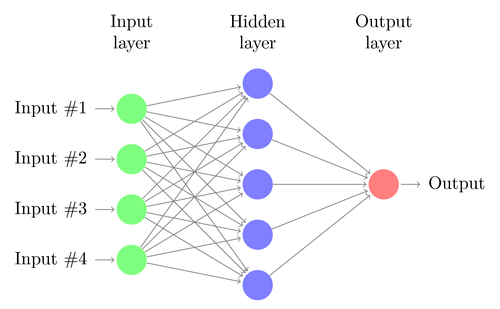

神经网络是一种模仿人脑结构及其功能的信息应对系统,可以提供智能化的信息应对平台。它是计算机科学、数学和生物学等多学科交叉的产物。神经网络的核心思想是通过模拟人脑神经元之间的连接办法来解决复杂的模式识别和预测疑问。神经网络由输入层、隐藏层和输出层组成,每一层包含多个神经元。神经元之间通过权重实行连接,这些权重决定了每个神经元对输入信号的贡献程度。

# 2. BP神经网络算法

BP神经网络是一种前馈神经网络,采用误差反向传播机制实行训练。BP算法的基本步骤如下:

- 前向传播:输入数据从输入层传递到隐藏层,再传递到输出层,经过一系列激活函数计算得到最终的输出。

- 误差计算:将网络的输出与实际标签实施比较,计算损失函数,衡量模型预测结果与真实值之间的差距。

- 反向传播:按照损失函数的梯度,逐层更新网络参数,即调整权重和偏置,使得损失函数最小化。

- 迭代训练:重复上述过程直到网络的性能达到预定的标准或是说收敛为止。

BP神经网络算法在许多领域中得到了广泛应用,例如手写数字识别、语音识别和自然语言应对等。BP算法也存在若干缺点,比如训练时间较长、容易陷入局部更优解、对初始权重敏感等。

# 3. 实践经验

在实践中,咱们发现BP神经网络算法在解决线性可分疑问时表现良好,但在解决复杂非线性疑问时可能将会遇到困难。选择合适的激活函数、优化算法和超参数也是加强模型性能的关键因素。例如在手写数字识别任务中,我们利用ReLU激活函数和Adam优化器,并通过交叉验证来选择的超参数组合。实验结果显示,BP神经网络在MNIST数据集上的准确率达到了97%以上。

二、卷积神经网络(CNN)的应用

# 1. 卷积神经网络的基本概念

卷积神经网络(CNN)是一种专门用于应对图像数据的深度学习模型。它借鉴了生物视觉系统的结构,通过卷积操作提取图像的局部特征,并通过池化操作减低特征图的空间维度,从而减少参数数量,升级计算效率。CNN的主要组成部分包含卷积层、池化层、全连接层和激活函数。

# 2. 实验原理

在本实验中我们将利用PyTorch框架实现一个基于MNIST数据集的CNN网络。MNIST数据集是一个广泛利用的手写数字识别数据集包含了60000张训练图像和10000张测试图像。我们的目标是训练一个CNN模型,使其可以准确地识别这些手写数字。

# 3. 实践经验

在实践中,我们首先构建了一个简单的CNN模型包含两个卷积层和两个全连接层。每个卷积层后面跟着一个ReLU激活函数和一个更大池化层。为了防止过拟合我们在全连接层之后添加了Dropout层。经过训练,该模型在MNIST测试集上的准确率达到了99%以上。这表明CNN在图像分类任务中具有显著的优势。

三、机器学习基础

# 1. 监督学习、无监督学习和强化学习

机器学习可分为监督学习、无监督学习和强化学习三种类型。监督学习是指在已知输入和输出的情况下通过训练模型来预测未知数据的输出。无监督学习是指在木有标签的情况下,通过聚类或降维等方法发现数据的内在结构。强化学习是指通过试错的途径,让智能体学会怎样去在特定环境中选用行动以更大化累积奖励。

# 2. 常见的机器学习算法

在机器学习中,常用的算法涵盖决策树、随机森林、支持向量机(SVM)、k近邻(KNN)等。决策树是一种基于规则的分类方法,通过递归地分割数据来构建一棵树形结构。随机森林是通过集成多个决策树来实施预测,可有效避免过拟合。SVM是一种基于间隔更大化原则的分类方法,适用于高维空间中的分类难题。KNN是一种基于距离的分类方法,通过计算新样本与训练集中各个样本的距离来确定其类别。

四、心得体会

通过本次实验,我们深刻体会到神经网络算法的强大之处,同时也认识到它们的局限性。BP神经网络在应对线性可分疑惑时表现出色,但在应对复杂非线性难题时可能需要更多的改进。而卷积神经网络则在图像分类任务中展现出卓越的能力尤其是在应对大规模图像数据集时。机器学习的基础知识为我们理解各种算法提供了坚实的基础,使我们可以更好地设计和优化模型。

在未来的研究中,我们能够进一步探索怎样去升级神经网络的泛化能力,减少过拟合现象,并结合其他领域的知识来改进现有的算法。同时我们也应关注伦理和社会作用方面的难题,确信人工智能技术的发展能够造福人类社会。

通过本次实验我们不仅掌握了神经网络算法的具体应用还积累了宝贵的实践经验。这些经验和知识将对我们未来的学习和研究产生深远的作用。